Πρόκειται για το είδος πεύκου Araucaria columnaris, που δεν αναπτύσσεται σε ευθεία αλλά με μια ελαφριά κλίση. Αυτή όμως η κλίση δεν είναι καθόλου τυχαία. Σε οποιοδήποτε μέρος του κόσμου και να αναπτυχθεί πάντα γέρνει προς τον ισημερινό.

Spoiler alert: Είχαν και οι δύο δίκιο!

Ο αμερικανός William Beaumont παρατήρησε για πρώτη φορά τις διαδικασίες που συνέβαιναν στο εσωτερικό ενός στομάχου σε έναν ζωντανό άντρα, στον οποίο ένας πυροβολισμός του είχε δημιουργήσει μια βαθιά πληγή που δεν επουλωνόταν.

Θέματα

-

Αθλητισμός

-

Διατροφή & Μεταβολισμός

-

Οικολογία & Περιβάλλον

-

Βιοτεχνολογία

-

Υγεία & Φάρμακα

-

Τεχνολογία

-

Χιούμορ

-

Βιοχημεία & Μοριακή Βιολογία

-

Γενετική & Εξέλιξη

-

Φυσιολογία & Ανατομία

-

Βιοφυσική

-

Αστροβιολογία

-

Περιποίηση & Φροντίδα του σώματος

-

Βιοηθική

-

Ψυχική Υγεία

-

Παραδοσιακή Ιατρική

-

Ζωολογία

-

Οικονομία

-

Υγιεινή διατροφή

-

Επιστημονική κοινότητα

-

Ψυχολογία

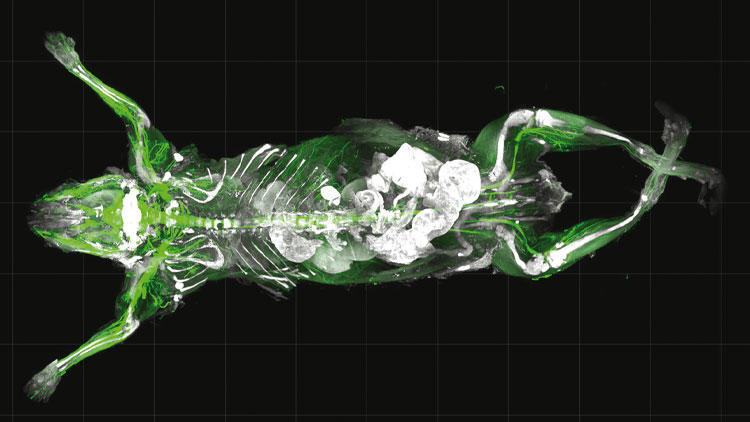

Η τεχνική αυτή φανερώνει τα ανατομικά μυστικά των ποντικών και αποκαλύπτει εντυπωσιακές λεπτομέρειες για το πώς ανταποκρίνεται το σώμα ενός ζώου σε ένα τραύμα.

Το ακραίο περιβάλλον του Θιβέτ, με την τόσο χαμηλή συγκέντρωση οξυγόνου, είναι ένα χαρακτηριστικό παράδειγμα τοπικής προσαρμογής και φυσικής επιλογής στην εξέλιξη του ανθρώπου.

Οι περισσότερες εμπειρίες και δραστηριότητές μας δεν αφήνουν κανένα σημάδι στη μνήμη. Η μάθηση δε νέων πληροφοριών, για ένα διαγώνισμα, για παράδειγμα, ή για να κάνετε μια νέα διαδικασία στη δουλεία απαιτεί συχνά πολύ προσπάθεια και επανάληψη. Εύκολα ξεχνάμε τι μάθαμε και πολλές φορές δυσκολευόμαστε να θυμηθούμε λεπτομέρειες από το παρελθόν μας.

Όμως κάποιες εμπειρίες μας κυνηγάνε για χρόνια. Τραυματικές εμπειρίες που απείλησαν τη ζωή μας, μια κλοπή, μια επίθεση ή μια φωτιά, είναι αδύνατο να ξεχαστούν ακόμη κι αν προσπαθείτε.

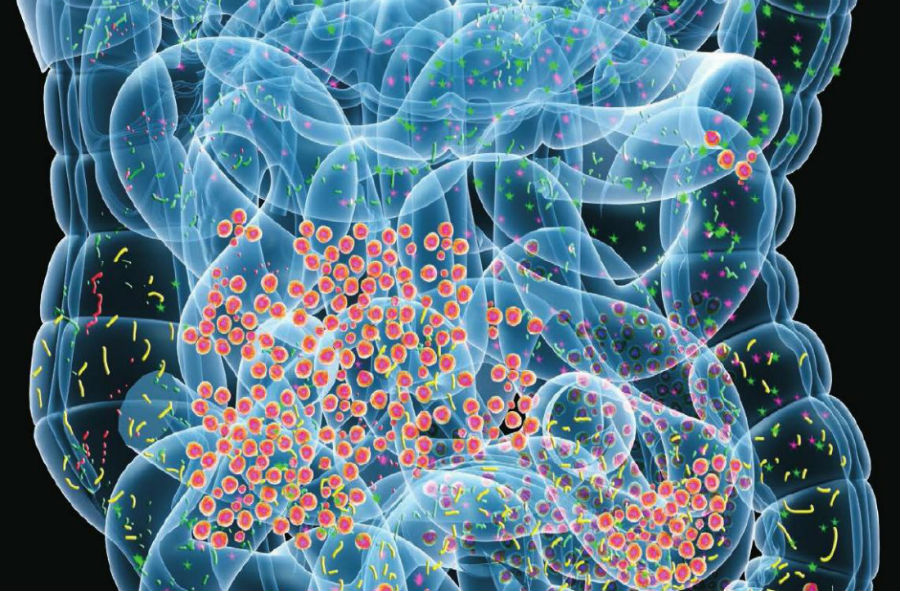

Αν αλλάξετε τον κιρκάδιο ρυθμό σας, αλλάζετε και τον ρυθμό των μικροβίων που ζουν στο σώμα σας.